Resident Evil Requiem se vend comme des petits pains

Capcom se félicite d'avoir écoulé 5 millions d'exemplaires de Resident Evil Requiem, en autant de jours. Le succès est total pour le neuvième épisode canonique, et c'est amplement mérité.

Capcom se félicite d'avoir écoulé 5 millions d'exemplaires de Resident Evil Requiem, en autant de jours. Le succès est total pour le neuvième épisode canonique, et c'est amplement mérité.

Sujette à des fuites d'hélium, la fusée SLS destinée à la mission Artémis II est en cours de maintenance. Les réparations progressent, ce qui ouvre la perspective d'un décollage du vol habité pour avril 2026.

Honda a lancé sa toute première moto électrique, la WN7 et Numerama a pu l'essayer en avant-première dans le sud de l'Espagne. Le constructeur de deux-roues n°1 dans le monde a-t-il trouvé la recette magique ? Voici notre verdict.

La partie 2 de la saison 4 de Bridgerton, mise en ligne le 26 février 2026 sur Netflix, contient l'une des scènes cultes des romans de Julia Quinn, se déroulant dans une baignoire. Une séquence très attendue, qui n'a pas été si simple à tourner pour Luke Thompson et Yerin Ha, les interprètes de Benedict et Sophie.

C’était prévisible, mais Highguard n’aura pas survécu bien longtemps après la vague de licenciements qui a frappé Wildlight Entertainment. Le studio confirme l’arrêt du free-to-play, moins de deux mois après sa sortie.

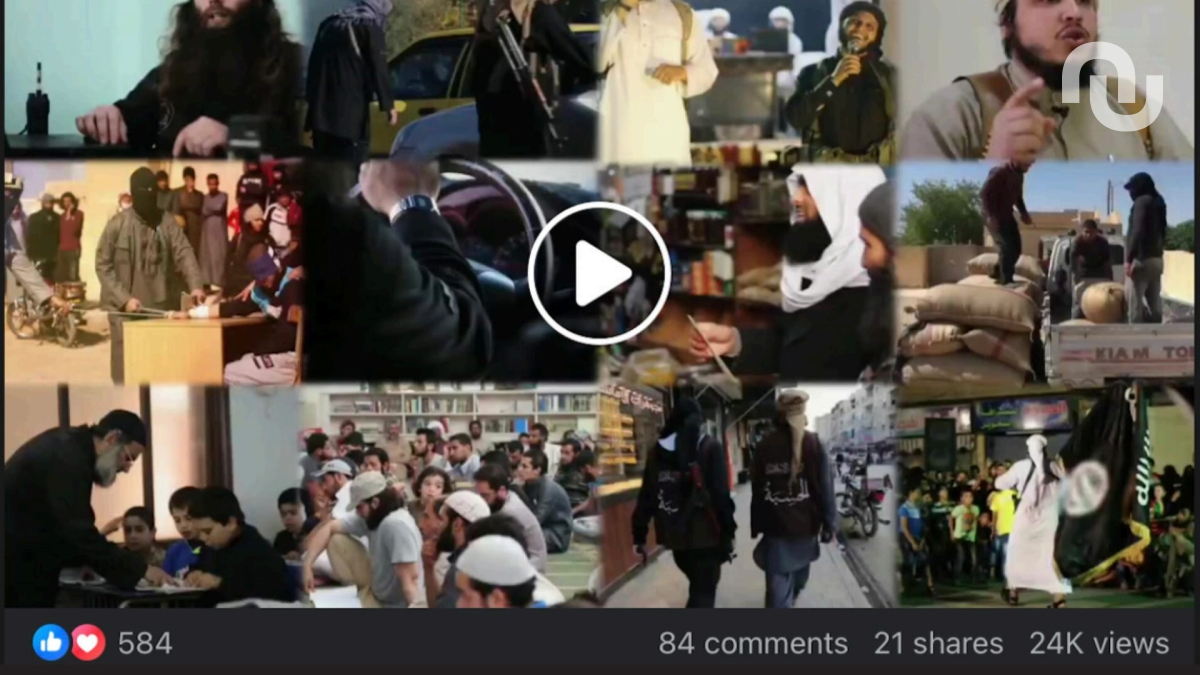

L’État islamique a perdu son territoire, mais pas sa capacité de diffusion. Selon un nouveau rapport de l’Institute for Strategic Dialogue, le groupe terroriste s’appuie désormais sur l’intelligence artificielle, des deepfakes et une stratégie multi-plateformes pour relayer ses messages.

Microsoft a présenté la première vague de jeux qui intégreront le Game Pass en mars 2026. Il y a du lourd avec Kingdom Come: Deliverance II et Cyberpunk 2077.

Google déploie en ce moment une icône redessinée pour son application Maps, abandonnant les partitions diagonales colorées au profit d'un dégradé inspiré de Gemini. Un changement qui, comme tout changement, ne plaît pas à tout le monde.

MilimoVideo, c'est un studio de production vidéo boosté à l'IA qui tourne entièrement en local sur votre ordi... pas de cloud, juste votre GPU qui mouline quoi...

Et contrairement à ce que vous pensez (je suis dans vos têtes !! lol), ce n'est pas un énième générateur prompt-to-video à la Sora . Non, il s'agit d'un vrai NLE ... ou plutôt un éditeur non-linéaire pour ceux qui découvre, avec une timeline multi-pistes, du trim au frame près et tout le toutim, sauf que derrière, y'a 4 modèles d'IA qui bossent ensemble main dans la main.

Du côté moteur, on retrouve donc LTX-2, un transformer dual-stream de 19 milliards de paramètres pour la génération vidéo. Text-to-video, image-to-video, interpolation de keyframes... c'est le package complet. Ensuite, pour les images, c'est Flux 2 Klein avec l'IP-Adapter qui maintient la cohérence visuelle de vos personnages d'un plan à l'autre, comme ça, finis les visages de vos acteurs qui changent toutes les 3 secondes.

Et y'a aussi SAM 3 pour la segmentation. Vous cliquez sur un objet dans la vidéo, hop, il le détecte et le suit alors automatiquement d'un bout à l'autre du clip. Et pour finir, Gemma 3 se charge d'améliorer vos prompts pour que les résultats soient plus "cinématiques".

Le truc cool, c'est surtout le système de "Story Elements" je trouve car avec ça, vous pouvez créer des personnages, des lieux, des objets, et vous les invoquez ensuite dans vos prompts avec un @Personnage. Du coup, le studio injecte les bonnes références visuelles pour garder une cohérence sur tout votre projet. Faut voir ça un peu comme des variables de code, mais pour du cinéma.

Et si vos plans dépassent 121 frames, le "Quantum Alignment" découpe la génération en morceaux et raccorde ces segments sans couture visible. Voilà comment les transitions entre bouts générés sont gérées proprement sans que vous ayez à lever le petit doigt. Magique hein ?

Pour voir ce que ça donne en pratique, voilà une démo qui montre le workflow complet :

Côté retouche, y'a aussi de l'inpainting (vous peignez un masque sur la vidéo et Flux 2 remplace la zone) et du tracking d'objets bidirectionnel. C'est carrément pas mal pour un projet open source sous licence Apache 2.0, vous ne trouvez pas ?

Après côté config, faut quand même du matos. Avec une carte NVIDIA, comptez 16 Go de VRAM (recommandés) et sur Apple Silicon, c'est M1 Max ou mieux avec 32 Go de RAM. Oubliez votre PC à 500 balles, quoi car en dessous de ces specs ça ne marchera pas.

L'ensemble s'installe via un git clone classique, le backend tourne sur FastAPI avec SQLite, le frontend sur React 18... et le tout communique en temps réel via SSE. Après, si vous êtes plutôt à la recherche d'un éditeur vidéo classique dans le navigateur , c'est pas le même délire, car là avec MilimoVideo on est dans la génération pure.

Bref, si les workflows ComfyUI à rallonge vous filent des boutons, MilimoVideo mérite donc le coup d'oeil.

Merci à Lorenper pour le partage !

Vous avez peut-être vu ça passer y'a pas longtemps, les scientifiques ne savent plus démêler le vrai du faux dans leurs propres publications. À NeurIPS 2025 , 100 citations hallucinées ont été retrouvées dans 51 papiers acceptés et à l' ICLR 2026, sur plus de 75 000 reviews analysées, 21% étaient entièrement générées par IA.

Bienvenue dans le monde du doute permanent !

Maintenant, si vous pensez que ça ne concerne que les chercheurs, détrompez-vous car de mon côté, ce que j'observe, c'est que les faux repos GitHub, c'est le même fléau côté tech, et surtout un vrai problème pour tous ceux qui relayent des projets open source comme moi.

Vous avez peut-être vu passer mon article d'hier sur WiFi DensePose , un projet à 25 000 étoiles sur Github qui promettait de détecter les postures humaines via le signal WiFi. Le code Python est détaillé, crédible en surface, il y a des tas d'issues ouvertes avec de vraies questions d'utilisateurs différents, des tas de pull requests parfaitement crédibles, une documentation hyper léchée... et le tout est adossé à un vrai papier de recherche de Carnegie Mellon .

Pour moi, ça avait l'air carrément sérieux ! Donc j'en ai fait un article.

Sauf qu'après coup, différentes personnes ont creusé plus profondément le code (Merci Nicolas), et ont trouvé des choses assez étranges partout dans le code. En fait, le truc générait des données aléatoires en se faisant passer pour du traitement de signal WiFi. C'est du vibe coding à l'état pur et quand des gens ont posé des questions dans les issues... ces dernières ont été vite supprimées. Faut dire que le piège était quasi parfait.

Et c'est tout le problème ! Car pour évaluer si un projet GitHub est légitime, je me base sur plusieurs signaux. Le code, les issues et les PRs, le nombre de stars, la reprise sur Reddit ou Hacker News, les commentaires, les articles dans la presse et quand je peux (et là c'était pas le cas car ça demande pas mal de matos que j'avais pas), je teste évidemment... Mais du coup, quand TOUS ces signaux sont fabriqués de toutes pièces, y'a plus aucun repère !

Parce que figurez-vous que les étoiles Github, ça s'achète (y'a des services entiers dédiés à ça), les issues se génèrent par IA, le code compile, les tests passent, le README est nickel, et le développeur a d'autres projets crédibles sur son profil. Vraiment tout est conçu pour que ça fasse parfaitement illusion.

Et comme ce sont souvent des projets émergents sur des technos de pointe, y'a pas grand monde qui a le matos ni le temps de vérifier par soi-même. Du coup, voilà comment moi et d'autres, on se retrouve à relayer des projets bidon sans le savoir. Et dire que j'étais à 2 doigts d'acheter le matos pour tenter l'aventure...

Les chercheurs se fient au peer review, aux citations, à la réputation du journal et moi c'est pareil avec les stars, les contributions, et le relai médiatique. Sauf que dans les deux cas, l'IA a rendu ces marqueurs de confiance complètement bidons. C'est pour ça que je fais ce parallèle car de mon point de vue, c'est le même combat.

Et le pire, c'est que c'est même pas du code malveillant. Y'a pas de backdoor, pas de malware planqué, pas de minage crypto en douce. C'est juste du code qui donne l'ILLUSION de fonctionner, ou plutôt, qui PRÉTEND fonctionner. Tout ça apparemment pour faire ce qu'on appelle du "portfolio padding"... c'est-à-dire gonfler son CV de développeur avec des faux projets open source à des milliers de stars pour impressionner les recruteurs.

Perso, j'avoue ça me dépasse.

Maintenant, comme c'est nouveau pour tout le monde, il va falloir apprendre à éviter de tomber dans le panneau. J'y ai réfléchi un peu et finalement, ça passe par une analyse plus approfondie du code et de l'historique du projet... On peut par exemple vérifier le git log parce qu'un projet à 25 000 étoiles et 3 commits en 2 semaines, c'est louche, donc méfiance. Et surtout, faut chercher des retours d'utilisation concrets et des issues techniques pointues. Après encore faut-il avoir des compétences techniques assez poussées (par exemple en traitement du signal) pour capter ce qui y est raconté... Pas simple hein ?

Faudrait peut-être que je me fasse un skill un peu poussé pour qu'une IA soit capable de faire ce taf chiant à ma place. Je vais y réfléchir.

Bref, on est tous dans la même galère, à devoir douter de tout ce qui brille sur GitHub et ailleurs et ça c'est bien emmerdant.

Savez-vous que Meta a vendu 7 millions de paires de Ray-Ban Meta l'an dernier ? Le succès commercial est dingue, mais une enquête du quotidien suédois SVD montre que des sous-traitants basés au Kenya visionnent certaines vidéos privées, enregistrées par les lunettes pour entraîner l'IA de Meta. La CNIL a ouvert une enquête.

EssilorLuxottica a confirmé le chiffre : plus de 7 millions de lunettes connectées vendues en 2025. C'est trois fois plus que les 2 millions écoulés entre le lancement fin 2023 et début 2025. La gamme s'est élargie avec les Oakley Meta et un modèle haut de gamme à 800 dollars, le Ray-Ban Meta Display, qui ajoute un affichage tête haute. Le marché des lunettes connectées n'est clairement plus un sujet de niche, et Meta domine le segment.

Selon l'enquête du quotidien suédois SVD, des milliers d'annotateurs de données basés au Kenya, employés par le sous-traitant Sama pour le compte de Meta, visionnent les vidéos captées par les Ray-Ban Meta pour entraîner ses modèles d'IA. Et ce qu'ils voient n'est pas toujours anodin. Les travailleurs rapportent être tombés sur des scènes de salle de bain, des moments intimes et des cartes bancaires filmées par les utilisateurs. Un employé raconte qu'un utilisateur portait ses lunettes pendant que son partenaire se trouvait dans la salle de bain. Les conditions d'utilisation de Meta précisent que les interactions avec l'IA peuvent être "examinées de façon automatique ou manuelle", mais on doute que les utilisateurs aient bien compris ce que "manuelle" veut dire dans ce contexte.

Côté protection des personnes filmées, la situation n'est pas mieux. Les Ray-Ban Meta ont une petite LED blanche qui s'allume pendant l'enregistrement, censée prévenir les gens autour. Sauf que certaines bidouilles permettent de la masquer, et la CNIL l'a bien noté. L'autorité française a ouvert une enquête après une plainte et considère que l'intrusion dans la vie privée est "possiblement énorme". Des créateurs de contenu ont d'ailleurs utilisé ces lunettes pour filmer des passants à leur insu, la BBC ayant documenté le cas de pick-up artists filmant des femmes dans des lieux publics. Et puisque filmer dans un espace public reste légal en France, les victimes n'ont quasiment aucun recours. Des étudiants de Harvard ont aussi démontré qu'on pouvait coupler les lunettes à un système de reconnaissance faciale pour identifier des inconnus dans la rue et accéder à leurs données personnelles.

On ne va pas se mentir, j'adore mes Ray-Ban Meta que j'utilise quotidiennement, mais 7 millions de caméras portées sur le nez de gens qui se baladent partout, avec des vidéos qui finissent chez des sous-traitants au Kenya, c'est quand même un problème. La politique de confidentialité de Meta reste volontairement floue sur ce qui est collecté et sur qui regarde ces images. La petite LED de sécurité qui se neutralise facilement n'aide en rien.

Sources : Clubic , UCStrategies

Alors que l'industrie de la tech subit de plein fouet l'explosion du coût des composants, Apple va en sens inverse avec le prix de ses derniers MacBook les plus puissants.

Un projet d'adaptation au cinéma de Game of Thrones a été rapporté par la presse américaine début mars. Reverra-t-on les acteurs et les actrices de la série ? Rien n'est moins sûr.

Avec ses nouveaux processeurs M5 Pro et M5 Max, Apple modifie en profondeur l'architecture de ses puces haut de gamme. Recours aux chiplets, introduction d'un troisième type de cœur CPU : les changements sont notables par rapport aux générations précédentes.

L’article Apple a tout cassé : les M5 Pro et M5 Max n’ont plus rien à voir avec avant est apparu en premier sur Tom’s Hardware.

L'émergence de l'IA agentique a entraîné une hausse inattendue de la demande en processeurs pour serveurs, provoquant des tensions sur la chaîne d'approvisionnement d'AMD qui cherche désormais à ajuster ses capacités de production pour répondre aux nouveaux besoins des centres de données.

L’article AMD débordé par une demande inattendue de processeurs serveurs pour l’IA agentique est apparu en premier sur Tom’s Hardware.

Windows 11 devient le système d’exploitation le plus populaire sur PC. D’après les dernières statistiques de StatCounter (février 2026), l'OS atteint 72,78 % de part de marché

Windows 11 devient le système d’exploitation le plus populaire sur PC. D’après les dernières statistiques de StatCounter (février 2026), l'OS atteint 72,78 % de part de marché

Cet article Windows 11 devient numéro 1, une bascule que personne n’a vraiment “choisie” ? a été publié en premier par GinjFo.

Un PC de bureau peut-il fonctionner sans prise secteur, uniquement grâce à des piles AA ? Un Youtubeur a relevé le défi

Un PC de bureau peut-il fonctionner sans prise secteur, uniquement grâce à des piles AA ? Un Youtubeur a relevé le défi

Cet article 56 piles AA pour 5 minutes de PC, le “speedrun” le plus stressant du monde a été publié en premier par GinjFo.

Le Service national des impôts sud-coréen a publié par erreur les phrases de récupération de portefeuilles crypto saisis lors d'une opération contre la fraude fiscale. Résultat, un inconnu a siphonné l'équivalent de 4,8 millions de dollars en quelques heures. Les fonds ont finalement été restitués, mais l'affaire fait quand même pas mal jaser.

Il y a quelques jours, le fisc sud-coréen annonçait avoir mené des perquisitions chez 124 contribuables soupçonnés de fraude fiscale, pour un butin total de 8,1 milliards de wons, soit environ 5,6 millions de dollars en espèces, montres et biens de luxe. Pour communiquer sur l'opération, l'agence a partagé des photos des saisies avec la presse. On y voyait des liasses de billets, des objets de valeur, et plusieurs portefeuilles Ledger posés bien en évidence sur une table.

Sauf que sur au moins deux d'entre eux, la seed phrase, cette suite de mots qui donne le contrôle total d'un portefeuille crypto, était parfaitement lisible. Un inconnu a repéré l'aubaine, déposé un peu d'Ethereum sur le wallet pour couvrir les frais de transaction, puis exécuté trois transferts pour vider les 4 millions de tokens Pre-Retogeum qui s'y trouvaient. Valeur estimée : 4,8 millions de dollars quand même.

Une vingtaine d’heures plus tard, les tokens ont été renvoyés à leur portefeuille d'origine. Pourquoi ? Parce que le Pre-Retogeum est un token quasiment invendable. Le volume de transactions quotidien sur les plateformes décentralisées ne dépassait pas 332 dollars au moment des faits. Concrètement, le voleur s'est retrouvé avec des millions en poche, mais sans aucun acheteur potentiel en face. Et comme toutes les transactions sont enregistrées sur la blockchain, toute tentative de revente aurait été immédiatement grillée.

C'est le deuxième incident du genre en Corée du Sud. En 2021, la police de Séoul avait perdu 22 bitcoins, soit environ 1,5 million de dollars, après les avoir confiés à un prestataire externe. Le vice-Premier ministre a donc ordonné un examen en urgence de la façon dont les administrations gèrent les actifs numériques saisis. Le fisc a présenté ses excuses, expliquant avoir voulu "fournir une information plus vivante au public", et a promis de revoir ses procédures de A à Z. La police a quand même été chargée de retrouver l'auteur du vol.

Franchement, publier la seed phrase d'un portefeuille crypto dans un communiqué de presse, il fallait quand même oser. C'est la deuxième boulette crypto du gouvernement sud-coréen, et visiblement, la gestion des actifs numériques par les administrations publiques est un sujet complexe pour les autorités.

Sources : the register , coindesk

Si vous utilisez ExifTool sur macOS, j'ai une mauvaise nouvelle pour vous ! Une faille critique vient d'être découverte dans cet outil que tout le monde (moi y compris) utilise pour lire et modifier les métadonnées des fichiers et c'est pas joli joli.

Cette vulnérabilité, référencée en tant que

CVE-2026-3102

, touche toutes les versions jusqu'à la 13.49 et c'est spécifique à macOS. Cela permet à un attaquant de planquer des commandes système dans les tags de métadonnées d'un fichier image et quand ExifTool traite le fichier avec le flag -n... les commandes s'exécutent directement sur votre machine.

L'exploitation est ridiculement simple et 2 étapes suffisent. On vous envoie une image qui a l'air parfaitement normale, vous la passez dans l'outil pour lire ses métadonnées, et l'injection de commande se déclenche. L'attaquant peut alors ensuite télécharger des payloads malveillants ou carrément se servir dans vos fichiers sensibles.

C'est l'équipe GReAT de Kaspersky qui a trouvé le problème. Bon après, la bonne nouvelle c'est que Phil Harvey, l'auteur du soft, a déjà sorti le correctif dans la version 13.50, et ça depuis le 7 février dernier... donc ça fait presque un mois que le patch est dispo.

Du coup, si vous avez des scripts qui traitent automatiquement des images avec ExifTool sur votre Mac, par exemple dans un pipeline de

forensique

ou d'

analyse EXIF

, vérifiez ILLICO la version installée (exiftool -ver pour checker). Comme la complexité d'exploitation est faible, n'importe quel script kiddie pourrait s'en servir, donc autant agir vite.

Pour mettre à jour, un petit brew upgrade exiftool et c'est réglé (sinon, le .pkg est dispo sur le

site officiel

). Attention, pensez aussi à vos scripts automatisés qui lancent ExifTool en arrière-plan, car c'est souvent là que les vieilles versions trainent...

Allez, bonne soirée les amis !