Comment configurer un VPN sur Apple TV ?

— Article en partenariat avec Surfshark VPN —

Vous le savez déjà parce que je vous le répète depuis des années, mais dans notre ère numérique, protéger sa vie privée en ligne et améliorer son expérience de streaming sont essentiels. Et aujourd’hui on va voir ensemble et en détail comment le faire sur une Apple TV.

En intégrant un réseau privé virtuel (VPN) sur votre smart TV, vous débloquez tout un monde de possibilités tout en assurant un accès sécurisé et illimité au contenu. Dans cet article, je vais creuser un peu les tenants et aboutissants de la configuration d’un VPN sur l’appareil de la pomme, en mettant en lumière ses fonctionnalités, ses avantages, et les meilleures options adaptées pour une intégration transparente. Et si vous n’avez pas de TV Apple ? J’ai déjà publié un article pour Surfshark VPN et n’importe quelle smart TV.

Comprendre les VPNs et Apple TV

Qu’est-ce qu’un VPN et comment ça marche ?

En 2024 je pense que tout le monde (au moins sur mon site) sait ce qu’est un VPN, mais dans le cas contraire je vais juste rappeler qu’il s’agit d’un outil qui permet d’établir une connexion sécurisée et chiffrée entre votre appareil et internet. En faisant transiter votre trafic internet par des serveurs distants, un VPN masque votre adresse IP et chiffre vos données, garantissant ainsi anonymat et confidentialité en ligne. Ce chiffrage assure que vos activités en ligne, que ce soit le streaming, la navigation ou le gaming, restent privées et sécurisées loin des regards indiscrets. Et cela même pour votre fournisseur d’accès (grâce au mode camouflage de Surfshark).

Les fonctionnalités de l’Apple TV

Une Apple TV disposant du tvOS, c’est un peu la machine de streaming révolutionnaire par excellence. Elle proposent une multitude d’options de divertissement, avec non seulement des services de streaming, mais aussi (depuis peu) des applications et des jeux. Par contre si l’Apple TV offre un accès fluide au contenu numérique il faut reconnaitre que sa connectivité internet native manque des fonctionnalités de sécurité robustes, mais aussi du déblocage géographique qu’un VPN peut offrir. En intégrant un VPN avec votre Apple TV, vous améliorez votre expérience de streaming, accédez au contenu géorestreint, et protégez votre vie privée en ligne simultanément. Que demande le peuple ?

Bref la trousse à outils par excellence, d’ailleurs je vous ai déjà détaillé tout cela. Mais pour résumer voilà les avantages d’utiliser un VPN avec Apple TV

- confidentialité améliorée : protégez vos activités en ligne des regards indiscrets et des potentielles violations de données en chiffrant votre trafic internet.

- Déblocage géographique : accédez au contenu restreint par région et contournez les restrictions de censure facilement, ce qui vous permet en plus de profiter d’une gamme plus large d’options de streaming (catalogues d’autres pays … par exemple le catalogue Netflix).

- Sécurité renforcée : protégez vos informations sensibles des hackers et des menaces en ligne en chiffrant vos données et en masquant votre adresse IP.

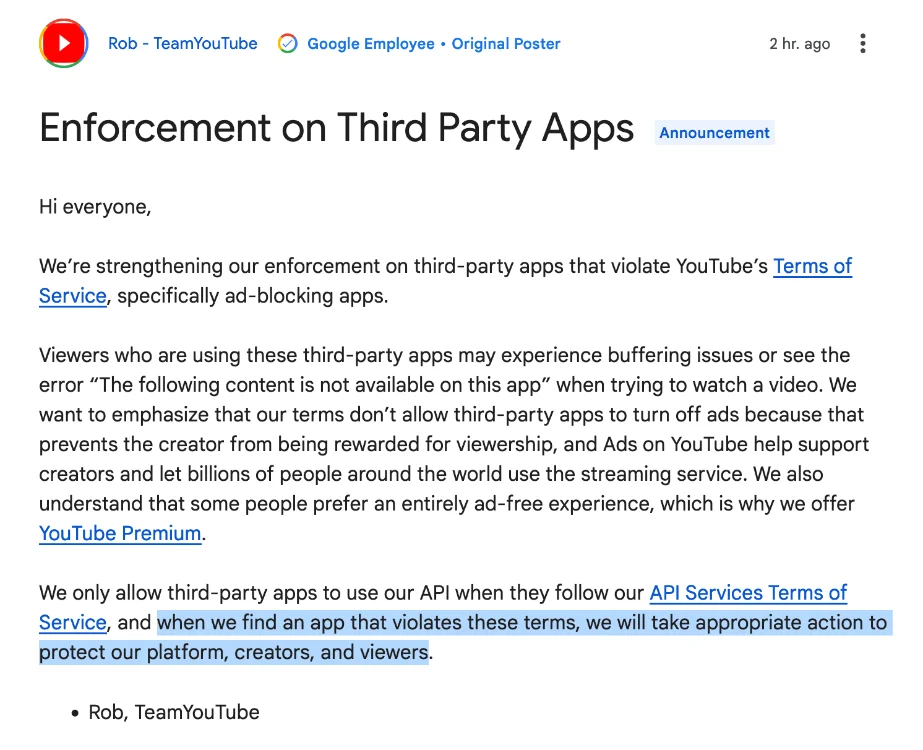

- Streaming optimisé : surmontez la limitation de vitesse imposée par votre fournisseur d’accès internet et profitez d’un streaming sans tampon de vos contenus préférés, garantissant une expérience de visionnage aux petits oignons

La possibilité de combiner les 2 est encore toute chaude donc toutes les fonctionnalités classiques du VPN ne sont pas encore intégrées : c’est le cas par exemple de la fonction Cleanweb (ça aussi je vous en ai déjà parlé), du MultiHop dynamique ou encore de l’IP fixe. Ces options devraient apparaitre dans un futur plus ou moins proche, en tous cas on peut l’espérer. Et je vous en reparlerai si c’est le cas.

Avez-vous besoin d’un VPN pour votre Apple TV ?

Si vous vous demandez s’il est obligatoire d’utiliser un VPN … la réponse est non. Je ne vous regarderai pas avec moins de bienveillance (encore que …). Mais si ce n’est pas une nécessité absolue pour utiliser Apple TV, il offre quand même de sacrés avantages qui améliorent votre expérience de streaming. Surtout si vous accordez de l’importance à la confidentialité, à la sécurité, ou à l’accès à une gamme plus large de contenu. Et encore plus si vous n’êtes pas trop égoïste et que vous pensez à protéger le reste de votre famille.

Parce que je vous rappelle quand même sur Surfshark VPN supporte un nombre de connexions … illimitées et simultanées. Ce qui reste un des gros points forts de l’outil VPN du requin.

Comment configurer un VPN ?

Voilà le moment que vous attendiez tous, mettre les mains dans le cambouis ! Configurer un VPN sur votre Apple TV peut se faire de plusieurs moyens, chacun adapté à votre configuration matérielle. On va creuser le processus étape par étape, et comme vous allez le voir il n’y a vraiment rien de bien compliqué.

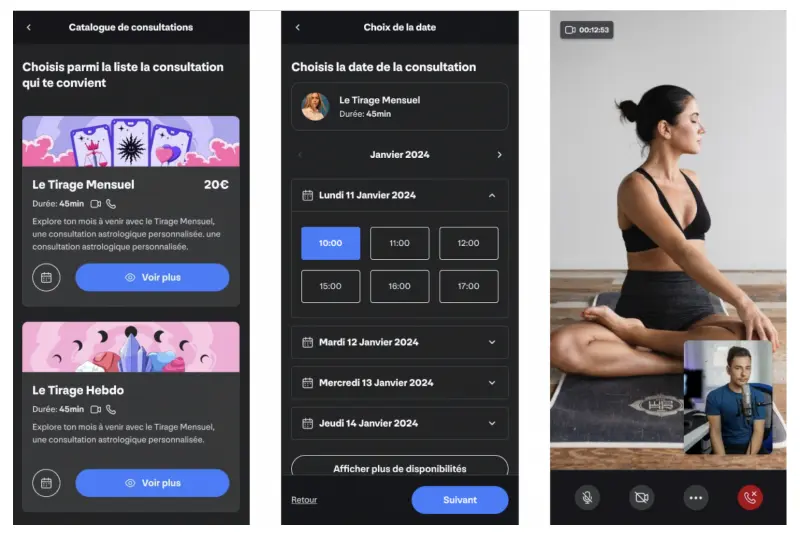

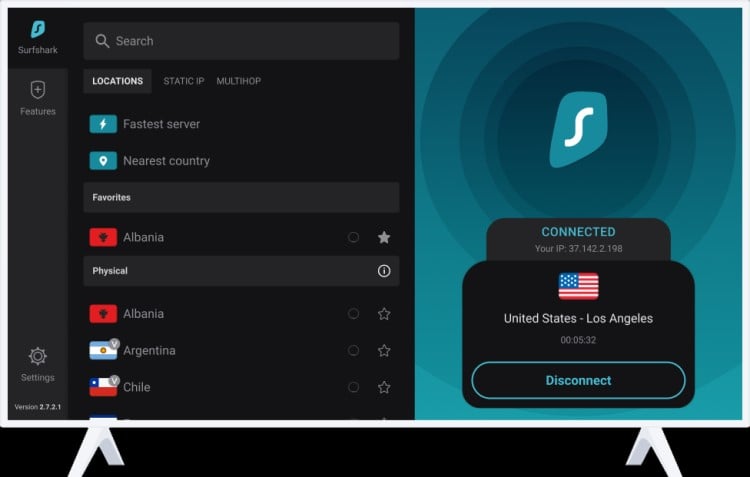

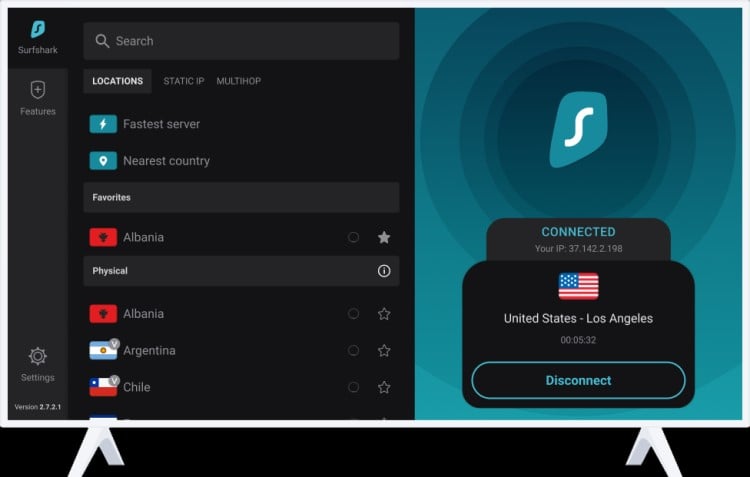

Si vous disposez d’une Apple TV HD ou un modèle 4K (pour les 3 premières générations, voir plus bas) : vous allez commencer par installer l’appli Surfshark sur votre appareil depuis l’App Store (Captain Obvious est parmi nous). Pour ouvrir l’appli, vous pouvez utiliser votre adresse mail habituelle ou directement votre compte Apple. Et pour la version mobile, il suffit de scanner le QR Code qui apparaitra sur l’écran. Jusque là même Mme Michu est encore dans le game.

Ensuite ? Rien, c’est fini. Ce n’est pas une démarche digne de la NASA, c’est ultra simple comme sur n’importe quel autre appareil et c’est fait exprès. Vous allez simplement vous connecter à des serveurs en choisissant un pays en fonction du catalogue de votre plateforme de streaming, du pays le plus proche, etc.

Éventuellement si vous avez des soucis de connexions, il faudra passer par les paramètres de votre Apple TV (Paramètres > Réseau > Détails de connexion > Supprimer VPN) et retenter la connexion. Et si vraiment vous avez du mal et que vous préférez voir de vos yeux comment ça marche, l’équipe a mis en place une vidéo YouTube dans laquelle on apprend que le protocole par défaut est Wireguard (bon choix).

Et si, comme je le mentionnais plus haut, vous disposez d’une télévision Apple des 3 premières générations ? Pas de panique. Elles ne supportent pas l’installation d’applis, mais il est toujours possible de passer par la fonction Smart DNS ou passer par un routeur.

Configurer un VPN sur votre routeur

- Accédez à la page des paramètres de votre routeur et localisez la section VPN.

- Entrez les identifiants VPN fournis par votre fournisseur de VPN.

- Enregistrez les paramètres et redémarrez votre routeur pour appliquer les modifications.

- Connectez votre Apple TV au réseau de routeur activé par VPN.

Configurer un routeur virtuel avec un VPN

- Installez un client VPN sur votre ordinateur portable ou de bureau.

- Configurez un routeur virtuel en utilisant les paramètres intégrés de votre appareil.

- Connectez le routeur virtuel à votre serveur VPN.

- Connectez votre Apple TV au réseau du routeur virtuel.

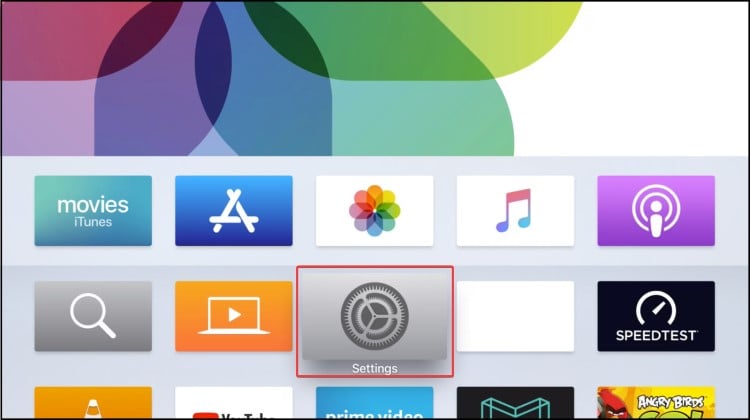

Configurer Smart DNS sur votre Apple TV

- Accédez au menu Paramètres sur votre Apple TV.

- Sélectionnez « Réseau » puis choisissez votre réseau Wi-Fi.

- Entrez les adresses DNS fournies par votre fournisseur de VPN.

- Enregistrez les paramètres et redémarrez votre Apple TV pour appliquer les modifications.

Comment choisir le meilleur VPN ?

Lors du choix d’un VPN pour Apple TV, prenez en compte les facteurs suivants :

- Compatibilité : assurez-vous de la compatibilité avec les appareils Apple TV pour une intégration sans faille.

- Vitesse et performance : optez pour un VPN avec des serveurs rapides et une latence minimale pour améliorer votre expérience de streaming. De ce côté Surfshark a frappé fort en passant la majorité de son parc de serveurs de 1Gb/s à 10 Gb/s ces derniers mois.

- Couverture serveur : choisissez un fournisseur de VPN avec un vaste réseau de serveurs pour des capacités de déblocage géographique optimales. Ce qui vous permettra d’accéder au contenu du monde entier, mais aussi d’avoir un temps de réponse plus rapide. Surfshark c’est 3200+ serveurs dans 100+ pays.

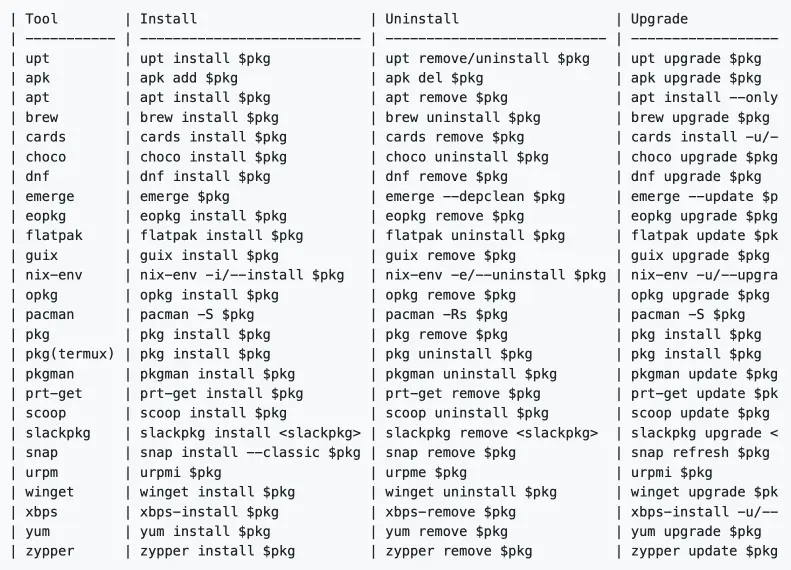

- Fonctionnalités de sécurité : les protocoles de chiffrement doivent être solides et reconnus (AES 256, ChaCha20, Wireguard, OpenDNS …), bouton kill switch, split tunneling, protection contre les fuites DNS sont des incontournables aujourd’hui.

Même si la plupart des fournisseurs de VPN offrent un support pour divers appareils, y compris Apple TV, c’est toujours mieux d’aller vérifier précisément si c’est vraiment le cas. Recherchez un VPN qui mentionne explicitement la compatibilité avec les appareils Apple cela vous garantira que vous n’allez pas vous retrouver dans la mouise à devoir bidouiller des solutions annexes ou demander un remboursement. Juste histoire de ne pas avoir de mauvaise surprise, on se prend déjà assez la tête ailleurs. Même si la plupart des outils proposent un remboursement sous 30 jours, vous savez comment ça se passe hein … y’a jamais de soucis pour que l’argent arrive chez eux, par contre pour le retour c’est pas toujours aussi simple. Au moins Surfshark est clair de ce côté, son outil est adapté.

Les meilleurs VPNs pour Apple TV

Alors, comme vous le savez je suis un utilisateur comblé avec Surfshark depuis plusieurs années, qui me convient très bien au quotidien avec très peu de lenteurs, etc. Mais on ne va pas se mettre des oeillères non plus et d’autres VPN font plutôt bien le taf de ce que j’en sais (mais eux sans avoir testé de manière concrète). Un petit tour rapide de quelques outils que je connais en mode bullet points (à prononcer en bon français, boulettes pwoiiiin) :

Surfshark VPN

- Avantages : connexions simultanées illimitées, fonctionnalités de sécurité robustes, et serveurs optimisés pour le streaming.

- Compatibilité : compatible avec les appareils Apple TV, intégration transparente, capacités de streaming améliorées, bibliothèques de contenu du monde entier …

NordVPN

- Avantages : vaste réseau de serveurs, serveurs dédiés au streaming, et protocoles de sécurité de premier ordre.

- Compatibilité : compatible avec les appareils Apple TV, accès illimité aux bibliothèques de contenu du monde entier.

ExpressVPN

- Avantages : serveurs ultra-rapides, interface conviviale, et excellent support client.

- Compatibilité : compatible avec les appareils Apple TV, streaming optimisé et des fonctionnalités de sécurité améliorées.

Et du côté des VPN gratuits ?

Vous connaissez déjà mon avis sur le sujet, oui il existe des bouses options de VPN gratuites. Le souci c’est qu’elles présentent souvent des limitations comme des quotas de données, des vitesses plus lentes, moins de serveurs et c’est blindé de pubs. Et, comme si ça ne suffisait pas, il n’y a pas non plus de niveau de sécurité minimal si vous faites attention à vos données. De plus il y a de très fortes chances que la plupart d’entre eux revendent vos données à divers organismes (il faut bien manger ma bonne dame). Si vous avez déjà essayé d’utiliser un VPN gratuit … vous savez que ça fait aussi mal que de marcher sur des tessons de bouteilles.

Pour des performances et une sécurité optimales, investir dans un service VPN payant réputé n’est pas un luxe. Performances fiables et stables, des fonctionnalités de sécurité robustes … rien de mieux pour diminuer sa dose de stress.

Surtout au prix actuel qui reste vraiment abordable depuis plusieurs années. On parle de moins de 2.75€/mois TTC avec l’abonnement 2 ans et 2 mois. C’est vraiment pas cher si vous avez 4 ou 5 machines à protéger ou que vous avez de la famille. Et du côté du paiement, Surfshark est plutôt flexible, vous pouvez payer d’un tas de manières différentes : PayPal, carte bancaire ou de débit, Google ou Amazon Pay, et même en cryptomonnaies (l’occasion d’enfin faire quelque chose de vos Ripple ou Cardano … haha). Toujours avec la garantie de 30 jours satisfait ou remboursé.

Je n’en ai pas parlé aujourd’hui parce que c’est déjà pas mal long, mais vous pouvez aussi ajouter diverses options à votre VPN si vous voulez une protection plus complète. Surfshark One (avec son antivirus, son système d’alerte, etc.) ou la version Plus (qui intègre le service Incogni) sont aussi à votre disposition pour quelques euros de plus.

Découvrir le VPN de Surfshark !